Aktuelles, Gastbeiträge - geschrieben von cp am Mittwoch, März 25, 2026 15:25 - noch keine Kommentare

Den Fortschritt im Blick, Cyberangreifer im Windschatten: Wie Unternehmen Governance, Risk & Compliance (GRC) mit KI harmonisieren

Künstliche Intelligenz entwickelt sich zunehmend zu einem entscheidungsrelevanten Faktor mit unmittelbaren Auswirkungen auf Risikoexposition, Haftung und regulatorische Anforderungen. Systeme treffen automatisierte Entscheidungen, priorisieren Risiken, analysieren Anomalien oder steuern Prozesse in Echtzeit.

Von unserem Gastautor Fino Scholl, Managing Director, Swiss GRC Germany

[datensicherheit.de, 25.03.2026] Künstliche Intelligenz verändert den Cybersecuritymarkt stärker als viele andere Innovationen der letzten Jahre. Geprüfte Studien zeigen: Die Identifikation von Schwachstellen in Software sowie die Entwicklung potenziell schädlicher Codes gelingt durch KI schneller, präziser und skalierbarer als je zuvor.

Diese Entwicklung verändert die Regeln. Für Verteidiger und Angreifer gleichermaßen. Denn KI wird zum Beschleuniger für beide Seiten. Die entscheidende Frage lautet daher nicht mehr, ob KI eingesetzt wird, sondern wie sie gesteuert wird. Was bedeutet das konkret für CTOs, CISOs und CSOs 2026?

Cybersecurity bleibt Herausforderung im deutschen Mittelstand

In vielen Unternehmen wird KI noch immer primär als Technologieprojekt verstanden. Zuständig ist die IT-Abteilung, bewertet werden Effizienzgewinne oder Automatisierungspotenziale. Diese Sichtweise greift deutlich zu kurz.

KI entwickelt sich zunehmend zu einem entscheidungsrelevanten Faktor mit unmittelbaren Auswirkungen auf Risikoexposition, Haftung und regulatorische Anforderungen. Systeme treffen automatisierte Entscheidungen, priorisieren Risiken, analysieren Anomalien oder steuern Prozesse in Echtzeit. Damit berühren sie nicht nur technische, sondern auch organisatorische und strategische Fragestellungen.

Gerade im deutschen Mittelstand fehlt häufig eine klare Governance-Perspektive. Es fehlt branchenunabhängig an Awareness, Expertise, Ressourcen und Infrastrukturen in diesem Bereich. Langfristig entsteht daraus ein erhebliches Risiko. Aus technologischer Hinsicht. Aber auch aus wirtschaftlicher. Denn schon 2025 entstand in Deutschland ein wirtschaftlicher Schaden von 202,4 Milliarden Euro durch IT-Angriffe. 2024 waren es noch 178,6 Mrd. Euro

Wer KI ausschließlich als praktikables Tool für Routinemaßnahmen betrachtet, unterschätzt ihre strukturelle Wirkung. Denn mit jedem KI-gestützten Prozess entstehen neue Abhängigkeiten, neue Angriffsflächen und neue Verantwortlichkeiten.

Effizienzgewinn vs. Sicherheitsrisiko

Unbestritten ist: KI kann Cyberabwehr deutlich stärken. Automatisierte Log-Analysen, Anomalieerkennung, prädiktive Risikoanalysen oder intelligente Zugriffskontrollen erhöhen die Reaktionsgeschwindigkeit erheblich. Sicherheitsvorfälle lassen sich früher identifizieren und priorisieren.

Gleichzeitig steigt jedoch die Komplexität. KI-Systeme basieren häufig auf externen Modellen, Cloud-Infrastrukturen oder Drittanbieter-Services. Trainingsdaten stammen aus unterschiedlichen Quellen, Algorithmen sind nicht immer vollständig nachvollziehbar.

Damit entstehen neue Risikodimensionen:

- Transparenzdefizite: Black-Box-Modelle erschweren Nachvollziehbarkeit und Auditierbarkeit.

- Drittanbieter-Abhängigkeiten: Externe KI-Services erweitern die Lieferkette und erhöhen Third-Party-Risiken.

- Neue Angriffsformen: Prompt Injection, Model Poisoning oder manipulierte Trainingsdaten eröffnen zusätzliche Angriffsszenarien.

KI wird so selbst zum Risikofaktor. Insbesondere dann, wenn sie unstrukturiert eingeführt wird.

Regulatorische Anforderungen erhöhen den Handlungsdruck

Parallel zur technologischen Dynamik steigt der regulatorische Druck. Mit NIS-2, DORA und dem Cyber Resilience Act rückt die Steuerung digitaler Risiken auf Management-Ebene. KI-Anwendungen fallen damit nicht mehr ausschließlich in den Verantwortungsbereich der IT, sondern werden Teil des unternehmensweiten Governance-, Risk- und Compliance-Frameworks.

Die regulatorische Logik ist eindeutig: Digitale Resilienz ist eine Führungsaufgabe. Risiken müssen identifiziert, bewertet, dokumentiert und kontinuierlich überwacht werden. Das gilt auch und insbesondere für KI-gestützte Prozesse.

Relevante EU-Maßnahmen im Zusammenhang mit KI und Cybersecurity, Bild: Swiss GRC Germany

Unternehmen stehen somit vor einer doppelten Herausforderung: Sie müssen KI nutzen, um wettbewerbsfähig und resilient zu bleiben. Gleichzeitig müssen sie sicherstellen, dass deren Einsatz kontrollierbar, prüfbar und regelkonform erfolgt.

Unterschätzte Risiken im KI-Einsatz

In der Praxis zeigen sich immer wieder miteinander vergleichbare Schwachstellen. Häufig werden KI-Tools dezentral eingeführt, etwa durch Fachabteilungen, die Effizienzpotenziale heben wollen. Governance-Strukturen hinken hinterher.

Typische Problemfelder sind:

- Fehlende Risikoklassifizierung: Nicht jede KI-Anwendung ist gleich kritisch. Ohne strukturierte Bewertung fehlt die Priorisierung.

- Unklare Verantwortlichkeiten: Wer haftet bei Fehlentscheidungen eines Systems?

- Mangelnde Dokumentation: Ohne transparente Prozesse sind Prüfungen kaum möglich.

- Unzureichendes Monitoring: KI-Modelle können sich durch Updates, neue Trainingsdaten oder Modellanpassungen verändern. Ohne kontinuierliche Kontrolle entstehen blinde Flecken.

Gerade regulierte Branchen in Deutschland, zum Beispiel der Finanzsektor, Versicherungen oder kritische Infrastrukturen, können sich solche Lücken nicht leisten. Hier wirken technologische Defizite unmittelbar auf Haftung, Reputationsrisiken und Geschäftsmodellstabilität.

Governance, Risk & Compliance (GRC) als strukturierender Rahmen

Die zentrale Frage lautet daher: Wie lassen sich Chancen und Risiken von KI systematisch steuern? Hier kommt Governance, Risk & Compliance (GRC) ins Spiel. GRC ist kein bürokratisches Add-on, sondern der strukturierende Rahmen, um technologische Innovation kontrollierbar zu machen.

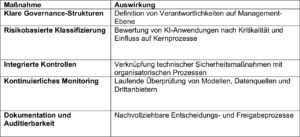

Ein wirksames GRC-Framework, Bild: Swiss GRC Germany

Erst durch die Einbettung in diesen Rahmen wird KI somit zu einem steuerbaren Bestandteil der Unternehmensarchitektur.

KI verstärkt bestehende Stärken und Schwächen

Ein häufiger Irrtum besteht darin, KI als Ersatz für Sicherheitsstrategien zu betrachten. Tatsächlich wirkt sie wie ein Verstärker. In Organisationen mit klaren Prozessen, definierten Zuständigkeiten und etabliertem Risikomanagement erhöht sie Effizienz und Transparenz.

In Unternehmen mit fragmentierten Strukturen verstärkt sie hingegen Intransparenz und Kontrollverlust. Cybersecurity 2026 wird daher nicht allein durch Technologie entschieden, sondern durch Governance-Qualität. Wer KI ohne strukturiertes Risikomanagement implementiert, verschiebt Probleme lediglich. Oft in Bereiche, die erst bei einem Audit oder Sicherheitsvorfall sichtbar werden.

Digitale Resilienz braucht Steuerbarkeit

- Die Ambivalenz von KI ist Realität: Sie ermöglicht präzisere Angriffe und gleichzeitig effektivere Verteidigung. Unternehmen können sich dieser Dynamik nicht entziehen.

Entscheidend ist, KI nicht isoliert als IT-Instrument zu betrachten, sondern als strategischen Faktor innerhalb der Unternehmenssteuerung. Digitale Resilienz entsteht dort, wo Innovation und Kontrolle zusammengedacht werden. - Für Entscheider bedeutet das: KI gehört auf die Agenda von Vorstand, Geschäftsführung und Risikokomitees. Nicht als technisches Detail, sondern als integraler Bestandteil von Governance, Risk & Compliance.

Denn ohne KI wird Cybersecurity 2026 nicht funktionieren. Aber ohne wirksames GRC wird KI zum unkalkulierbaren Risiko.

Fino Scholl, Managing Director, Swiss GRC Germany, Bild: Swiss GRC Germany

Fino Scholl ist Managing Director der Swiss GRC Germany GmbH und verantwortet den Ausbau des Deutschlandgeschäfts sowie die Weiterentwicklung der Marktaktivitäten des Unternehmens. Zuvor war er in leitenden Funktionen bei der IAV im Risiko- und Kontrollumfeld sowie in der industriellen Forschung tätig. Scholl promovierte im Maschinenbau an der Universidad de Valladolid und hält einen Masterabschluss der Karlsruhe University of Applied Sciences.

Weitere Informationen zum Thema:

datensicherheit.de, 08.11.2025

Einsatz von KI-Agenten: Lückenlose Governance für Unternehmen mittlerweile unerlässlich

datensicherheit.de, 04.07.2025

Intensive KI-Nutzung in Unternehmen – Entwicklung von Richtlinien und Governance fällt zurück

Aktuelles, Experten - Mai 10, 2026 0:01 - noch keine Kommentare

Warnung an Unternehmen: Gefälschte E-Mails der Verbraucherzentrale Hamburg

weitere Beiträge in Experten

- Unterschriftenaktion im Finale: Das Recht auf ein Leben ohne Digitalzwang gehört ins Grundgesetz

- Code-Test mittels LLMs: Komplexität Großer Sprachmodelle muss sich lohnen

- Trilog-Verhandlungen: TÜV-Verband bewertet Einigung zum KI-Omnibus ambivalent

- KI-Omnibus: Bitkom-Kommentar zu Kompromiss bei EU-Trilog-Verhandlungen über AI Act der EU

- Einsatz Digitaler Zwillinge durch mangelnde IT-Infrastruktur und Daten gebremst

Aktuelles, Branche - Mai 7, 2026 0:41 - noch keine Kommentare

Vermeintlicher Tech Support: Scam-Kampagne adressiert C-Level in Unternehmen

weitere Beiträge in Branche

- IT im Spannungsfeld zwischen Effizienz und Resilienz: Ganzheitliches Lieferketten-Management als Vorbild

- Cyberresilienz: Echtzeiteinblick in das Netzwerk für zentralisierte IT-Teams

- Deepfakes: Laut BSI-Bericht überschätzen Nutzer eigene Fähigkeit zur Erkennung

- World Password Day 2026: ESET-Empfehlung zur MFA-Nutzung für zentrale Zugänge zu Netzwerken und Konten

- Einloggen statt Einbruch: Warnung vor cyberkriminellem Trend

Aktuelles, A, Experten, Service, Wichtige Adressen - Jan. 13, 2026 1:08 - noch keine Kommentare

Registrierung bei ELEFAND: Krisen- und Katastrophenvorsorge bei Auslandsaufenthalten

weitere Beiträge in Service

- DigiCert-Umfrage: Manuelle Zertifikatsprozesse führen zu Ausfällen, Compliance-Fehlern und hohen Verlusten im Unternehmen

- Threat Hunting: Bedeutung und Wertschätzung steigt

- Umfrage: 71 Prozent der IT-Entscheidungsträger besorgt über Mehrfachnutzung von Passwörtern

- Fast die Hälfte der Unternehmen ohne geeignete Sicherheitsrichtlinien für Remote-Arbeit

- Umfrage: Bedeutung der Konsolidierung von IT-Sicherheitslösungen

Kommentieren